Après que Meta a annoncé qu’il tiendrait sa prochain modèle d’IA multimodale hors d’Europe, l’entreprise a désormais publié Llama 3.1, un modèle d’IA open-source dont les performances rivalisent avec celles de ChatGPT et Google Gemini. Le modèle compte maintenant 405 milliards de paramètres, obtenus grâce à un entraînement sur 16 000 GPU Nvidia de niveau entreprise. Qu’est-ce que cela signifie pour vous, à part une angoisse existentielle sur combien cela a dû coûter en argent et en énergie ? De meilleures conversations dans Meta AI et une nouvelle fonctionnalité qui peut générer des images d’IA mettant en vedette votre visage.

C’est le plus grand modèle d’IA open-source à ce jour, et l’entreprise collabore déjà avec des géants comme Amazon, Microsoft et Google pour aider les développeurs à l’intégrer dans leurs applications. Il est également gratuit à télécharger ici, et les développeurs peuvent même l’utiliser pour améliorer leurs propres modèles. Les non-développeurs feraient probablement mieux d’utiliser la version déjà intégrée dans WhatsApp et Meta AI, bien que les utilisateurs soient rétrogradés de la version à 405 milliards de paramètres à celle de 70 milliards s’ils sollicitent trop le chatbot.

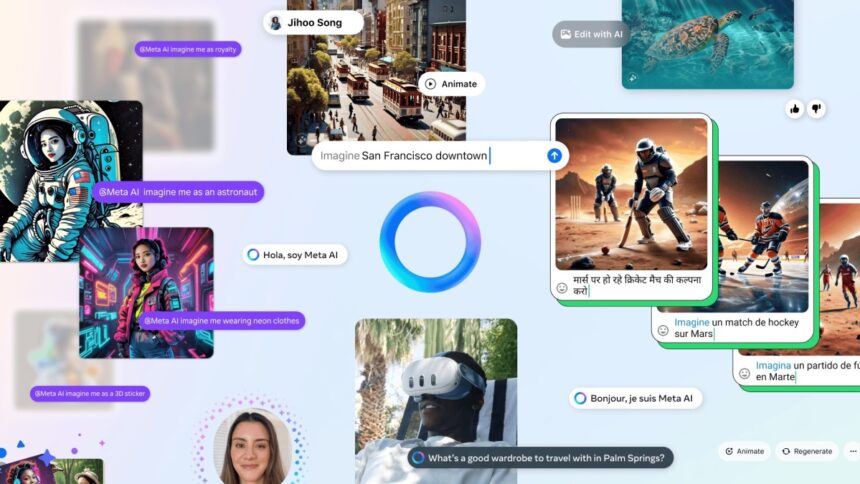

Crédit : Meta

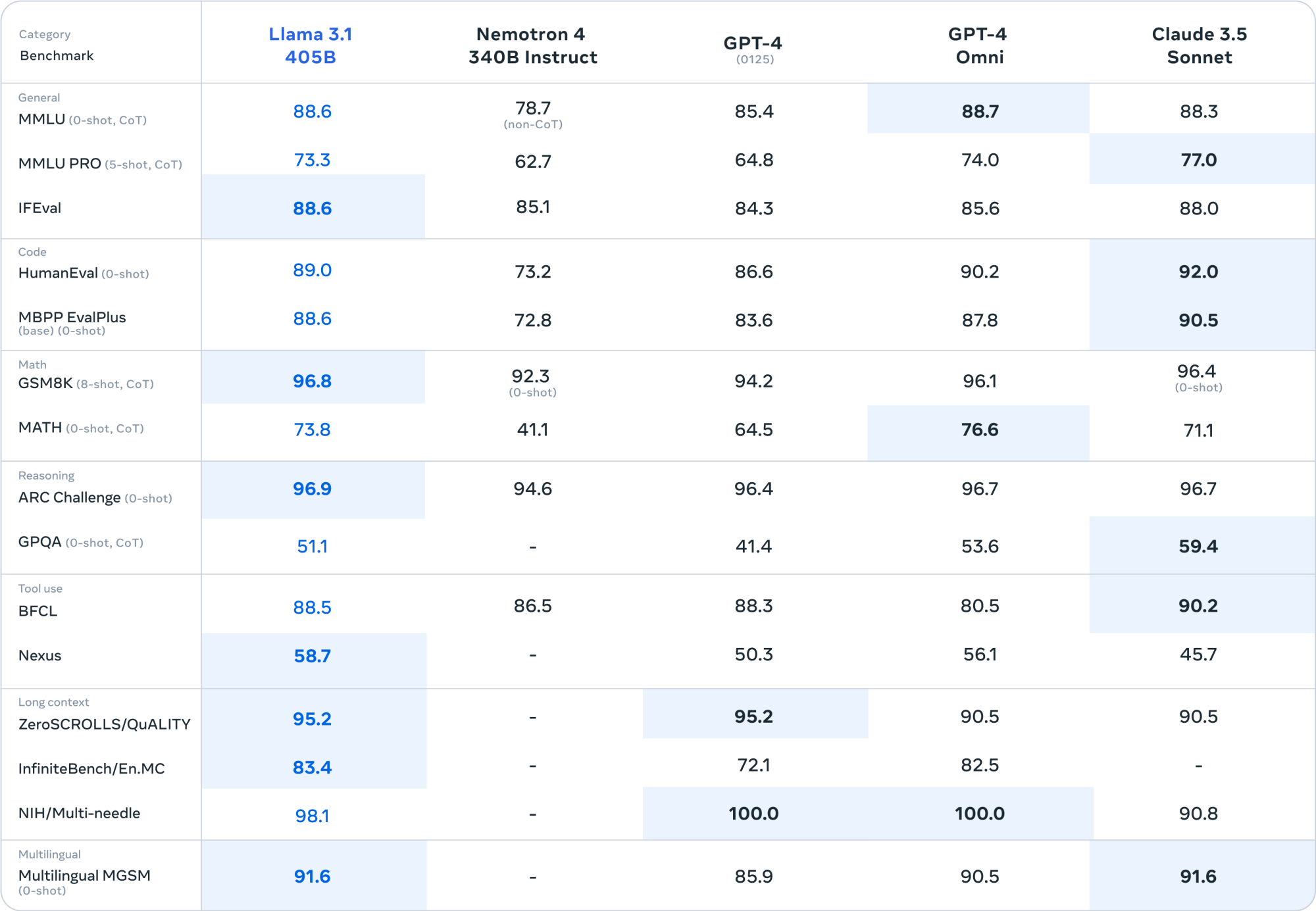

Selon les chiffres de référence publiés par Meta, Llama 3.1 a performé dans quelques points des autres modèles sur la plupart des tâches, parfois au-dessus et parfois en dessous, avec GPT-4o et Claude 3.5 Sonnet offrant la compétition la plus rude. Les utilisateurs ne remarqueront probablement pas de différence, mais Meta parie sur la combinaison de performances et de disponibilité open-source pour séduire davantage de développeurs.

En plus d’avoir plus de paramètres, Llama 3.1 prend également désormais en charge le français, l’allemand, l’hindi, l’italien et l’espagnol. Instagram et Facebook sont un peu en retard pour recevoir la mise à jour, mais Meta affirme que les réseaux sociaux seront mis à jour dans les prochaines semaines.

En ce moment, la façon la plus impressionnante de tester Llama 3.1 est la nouvelle fonctionnalité Imagine Me, qui permet à l’IA de scanner votre visage et ensuite de l’intégrer dans des images d’IA. Vous pourriez demander au bot de vous transformer en astronaute ou de vous représenter avec une couleur de cheveux différente. En réponse à Genmoji d’Apple, vous pouvez même utiliser “Imagine Me” pour générer des autocollants de vous-même.

Meta rend également possible l’utilisation de Meta AI lors de la création d’un post sur Facebook ou Instagram, ce qui pourrait faciliter le marquage des images générées par IA sur le site, puisque les posts réalisés de cette manière seront déjà marqués. Si vous ne pouvez pas les battre, rejoignez-les, je suppose.